前回はゲームの歴史を振り返りながら、没入感と身体性の関連性についてみていきました。映像表現が高度化する中で、ユーザの没入感を増大させるため、身体性が再び重要度を増している現状がありましたが、それを裏付けるかのようにその後のE3 2009では噂通り身体性をインターフェイスとする新しいコントローラが発表されました。

SCEIが発表したモーションセンサーと2Dカメラを組み合わせた「PlayStation Motion Controller」

これらはもちろん、ゲーム機用のコントローラですが、今回は、コンピュータやウェブのインターフェイスとして身体性はどのように取り込まれているのかを見ていきたいと思います。

コンピュータやウェブのインターフェイスとしては、その名の通り、机の上のメタファーとしてのデスクトップに配置されたボタンやアイコン、それをマウスによるクリックとキーボードによる文字入力でコントロールしていくというGUI+マウスとキーボードというのが、初代マッキントッシュがブレイクして以降今日まで35年間不動の地位を築いています。それはコンピュータの画面が2Dである以上、キーボードによる文字入力と前後左右に平面的に自由なマウスの動きというのがある意味必要最低限であるからに違いありません。

1984年のMacintoshのデスクトップ映像

そしてそれから35年後のMacに搭載されるSnow Leopard

性能は大きく向上したものの、ユーザーインターフェイスの根幹は全くかわっていません。

しかしマウスとキーボードというインターフェイスが必要十分なものとはいえ、問題点がないとは言えないように思います。例えば、マウスの操作1つ、キーボードの入力1つとってみても、学習コストは低いとはいえ、ダブルクリックやドラッグ、キータイプといった操作は直感的に行えるものではなく、練習しなければできるようにはなりません。初心者がはじめてマウスやキーボードを使ったときに、その操作ができない様子を見たことがあるかと思います。さらには、たとえ学習したとしても、実世界でのインタラクションとのギャップが大きいということがあります。現状のコンピュータのインターフェイスでは、例えば天気予報を知りたいと思ったときに、PCの電源を入れて、ブラウザを起動して、ブラウザのURLを入力する、もしくは検索してようやく天気予報を見ることができるという流れになっています。つまり行動と得たいと思う情報の相関関係が希薄で直感的ではなくなっています。つまり、GUI+マウスとキーボードというインターフェイスの問題点としては、

- ユーザの作業空間が狭く、ユーザのアクションに対するフィードバックが弱い。さらに実世界でおこるインタラクションとのギャップが非常に大きい

- 1つのデスクトップは基本的に1人のユーザに紐付けられ、1つのデスクトップを複数ユーザで同時にインタラクションを起こすようなことはできない

- 例えば、マウスのクリックでは複数点を同時に認識することができないなど、直感的な動作ではないし、コントロールに習熟するためには多少なりとも学習を必要とする

もっと具体的に言えば、つまりは、ウェブを含めコンピュータの進化による広がりは人と人、情報と情報を結びつけ、ある種のメディアと言ってもよい状況になっています。しかし例えばテレビが同じメディアでありながら、その存在をユーザに感じさせないほどに浸透し、非常に直感的なインターフェイスであることから、意識せず使える、ある意味透過的な存在となっているのに対して、コンピュータはそのインターフェイスが故に、逆に存在感を増している状況になっているように思われます。

そのようなコンピュータがコモディティ化し、メディア化したことで、多くの様々な人々が使うようになったという変化を受け、身体性をより強く加味することで、新しい体験を提供し、さらによりユニバーサルで直感的かつ透過的なインターフェイスを模索しようとする動きも近年大きくなりつつあります。

その中でも、注目すべきものに次の2つのアプローチがあります。

- Perceptual User Interface(PUI)

- Tangible User Interface(TUI)

PUIは身振り手振りといったいわゆるジェスチャーや音声によってコントロールするというもので、TUIはデジタル情報に物理的に接触することによってコントロールするというものです。

例えば、

このPUIやTUIを一躍有名にした、

MITメディアラボ監修で作られたトム・クルーズの映画「マイノリティーリポート」のコンピュータを操作するシーン

マイノリティーリポートを監修したMITメディアラボチームが作ったウェアラブルコンピュータ「six senth」

ジェスチャーでデスクトップをコントロールできる「GoMonkey」(Perceptual User Interfaceの1例)

情報を「手」で触ることができる「Microsoft Surface」(Tangible User Interfaceの1例)

6人同時にオブジェクトを動かすことにより奏でるシンセサイザー「Reactable」

iPhoneの画面をなぞることで画面に絵を描くことができる「Graffiti Wall」

などが例としてはあげられます。

マウスとキーボードではなく、それぞれ異なるアプローチながら、身体性をユーザインターフェイスに取り入れることで、身体の動きがそのままデジタルなものに対するコントロールを意味することになり、より学習コストを軽減し、ユニバーサルで直感的なUIを提供することで、マウスとキーボードというインターフェイスの限界を超えようとしています。

例えば、iPhoneはTUIを取り入れたことで、3歳の子供でも普通の携帯の操作はわからなくてもiPhoneの操作はわかるということをよく耳にするように、まさに透過性の高いインターフェイスとして、幼い子供からお年寄りまで幅広い層にリーチできたと言えるでしょう。もちろん身体性を取り入れたこれらのインターフェイスは既存のインターフェイスとは大幅に異なるため、ユニバーサルアクセスという側面以外にも新しい体験による刺激をもたらすことは言うまでもないでしょう。

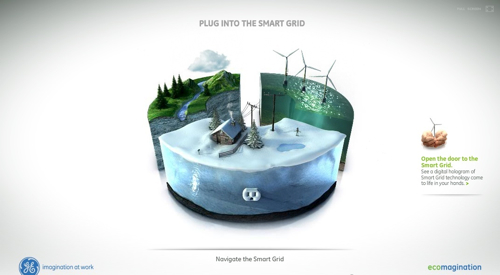

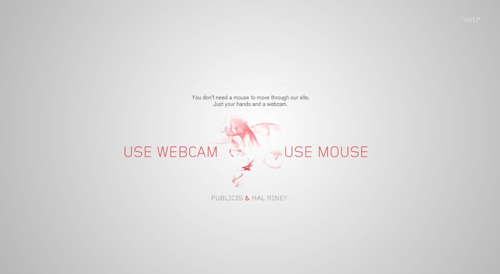

さらにこのようなPUI/TUIの流れはコンピュータそのもののインターフェイスにとどまらず、ウェブにおけるインターフェイスでもFlash、Ajax 等の表現力の高まりにより、ウェブサイトに対するユーザインターフェイスとして、取り入れられ始めています。Google Maps/Earthもある意味TUIと言えるでしょうが、そのほかにも特徴的なTUIのサイトとして

カメラとマイクを使い、ジェスチャーや声がサイトナビゲーションになるサイト

マウスで筆の動きをコントロールし、筆の太さはマイクを利用して声によりコントロールするドローイングサイト。

カメラを使って、ユーザのジェスチャーがサイトナビゲーションになるサイト

などがあげられます。さらには、例えばyugop.comの心地よさというのは、クリックというインターフェイスをとりながらも、極めてTangibleな感覚をユーザに与えるからにほかならないでしょう。GEのSmartGridのように、FLARToolkitが開発されたことによるFlashによる拡張現実サイトの流行も、ある意味現時点の実世界におけるTUIの先駆けとみなしてもいいように思います。拡張現実は上記six senthのように、将来的にはプロジェクタ型のもの、もしくはドラゴンボールのスカウターのようなHUDとして生活の一部に透過的な存在として、組み込まれていき、実世界にTangibleでPerceptualな新たな世界を生み出すことになると思われます。

もちろんこれらウェブサイトでのPUI/TUIの事例は、ユニバーサルアクセスという側面よりも、実験的、さらにはユーザに新しい体験をもたらすという側面が大きいでしょうが、ウェブサイトからのアクセスという極めてリソースが限定されている中でも、身体性がウェブサイトナビゲーションの一部として取り入れられ始めているというのは注目に値します。

ここまで、コンピュータそのものの、そしてウェブのインターフェイスを見てきました。 現時点では、まだまだ実験的な要素が多いのも事実です。

しかし冒頭のPlayStation Motion Controllerと時を同じくして、E3でマイクロソフトから発表されたPUI/TUIのコントローラ「Project Natal」がその状況をいっぺんさせるかもしれません。

E3 2009: Project Natal Milo demo

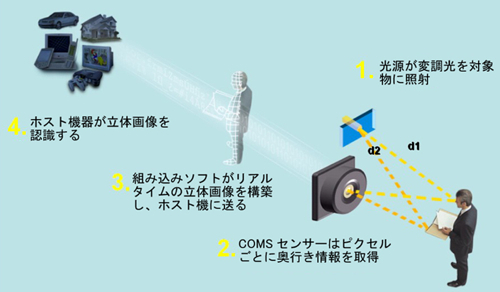

従来のカメラが映像を2次元的にとらえるのに対して、対象物に不可視光線を照射し、反射させることで反射時間(Time of Flight:TOF)を利用して対象物までの距離を測定し、映像を3次元的に測定することができる3Dカメラを利用することによって、上記のような PUI/TUIを実現しているのがこのProject Natalの大きな特徴です。

そして最も注目すべきなのは、家庭用ゲーム機の周辺機器として発売できるくらいの価格帯でこのようなインターフェイスが実現できるところまでおりてきているということです。しかもゲームで使えるほどのリアルタイム性と精度を持って。

つまりはProject Natalは早ければ来年2010年、遅くとも2011年には発売されると言われています。競合他社をふくめ、その頃には従来のカメラに変わって、3Dカメラが、しかも手頃な価格で市場に出回るということを意味します。そして遅くとも2015年位までには普及することになるでしょう。これにより、コンピュータはもとよりテレビなどの家電にも3Dカメラが搭載される可能性があります。そうなると、PUI/TUIの世界が一挙に身近なものとなり、旧来のマウスとキーボードをインターフェイスの主役の座から引きずりおろすことになるかもしれません。

SFや映画の世界にしかなかった、身体性をとりいれ、直接的に感覚に訴えかけるPUI/TUIが主流となる時代がすぐそこまできているのです。ユーザインターフェイスに大きなうねりを作ることになるであろう3Dカメラには今後とも注目していきたいと思います。